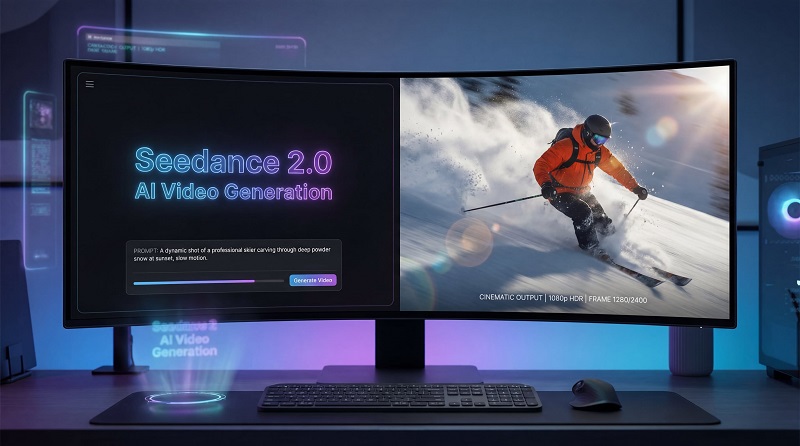

Seedance 2.0: Uma Nova Era de Geração de Vídeo com IA da ByteDance

No início de 2026, o Seedance 2.0 da ByteDance está agitando a comunidade de vídeos de IA. Este modelo de geração de vídeos multimodal começou testes internos limitados na plataforma Jimeng (Dreamina) por volta de 7 de fevereiro, com muitos usuários já experimentando. É um produto simbólico na transição de vídeos de IA de 'brinquedos experimentais' para 'ferramentas de produção controláveis e profissionais'. A equipe Seed da ByteDance criou o Seedance 2.0 com base no DNA de vídeos curtos do TikTok e CapCut, transformando-o em um modelo que realmente "cria como um diretor". Não depende apenas de prompts de texto, permitindo entradas mistas de texto + imagem + vídeo + áudio para controle preciso de detalhes.

1. Seedance 2.0: Tecnologia e Inovação Principal

O Seedance 2.0 é baseado em uma estrutura de Transformer de difusão de ramificação dupla com cerca de 4,5 bilhões de parâmetros, e seu maior trunfo é o sistema 'Universal Reference'. Os usuários podem fazer upload de até 12 arquivos de referência mista de uma só vez:

- Fixa a aparência, roupa e estilo dos personagens com imagens

- Replica trabalhos de câmera complexos, ritmo de movimento e efeitos especiais com clipes de vídeo

- Conduz a atmosfera geral com áudio + gera automaticamente efeitos sonoros, BGM e sincronização labial

- Direções detalhadas de narrativa, emoção e linguagem de filmagem com texto

Graças a este controle multimodal, problemas de 'colapso', aleatoriedade e consistência são altamente melhorados, tornando a saída mais próxima de filmagens reais ou edição profissional.

2. Visão Geral das Características Principais

- Resolução e Comprimento: Suporte a saída nativa de 2K, 4 a 15 segundos gerados de uma vez (até 60 segundos ou mais com extensão), consome cerca de 30 pontos por vídeo de 15 segundos, geração rápida e baixa taxa de descarte

- Narrativa Multi-shot: Suporte para transições de cena, tomadas contínuas, ligações de shots com One Native, adequado para narrativas complexas como dramas, comerciais e trailers de jogos

- Geração Nativa de Áudio-Vídeo: Sincronização labial em nível de fonema (suporte a múltiplas línguas e dialetos), correspondência automática de sons ambientais, sem necessidade de pós-produção

- Realismo Físico e de Movimento: Adoção de 'campo sonoro físico' e 'pré-treinamento de modelo mundial' melhora drasticamente a expressão física em cenas de luta, esporte e natureza

- Ferramentas de Edição Integradas: Possibilita trabalho repetido rápido com substituição de personagens, expansão de tela, inpainting e ligação de shots

A reação da comunidade é explosiva, com muitos usuários dizendo que "os movimentos são suaves, a consistência de estilo é excelente e o realismo é impressionante", especialmente em transições de animação, cenas de artes marciais e vídeos publicitários de alta qualidade, chegando ao nível de edição profissional.

3. Como Usar e Onde Acessar

Atualmente, o Seedance 2.0 pode ser experimentado principalmente na plataforma Jimeng da ByteDance (jimeng.jianying.com), acessível via aplicativo ou web do CapCut. É necessário inscrever-se (mínimo de 69 yuan/mês) para adquirir pontos. O processo de geração é o seguinte:

- Faça o upload dos arquivos de referência (máximo de 9 imagens + 3 vídeos/áudios, comprimento total ≤15 segundos)

- Digite o prompt (ex: “Noite, uma antiga taverna de madeira. As lanternas balançam ao vento, com uma mistura de embriaguez e tensão no ar. Uma mulher de preto se senta no meio, colocando o copo. Com o som da porta da taverna fechando, assassinos cercam silenciosamente.”)

- Especificar tags de referência (ex: fixar personagem com @image1, replicar shot com @video1)

- Edite e estenda imediatamente após a geração

- Plataformas de terceiros como Atlas Cloud, WaveSpeedAI, Imagine.Art devem oferecer suporte a API em meados de fevereiro. Iniciantes devem começar com prompts simples e adicionar referências gradualmente.

4. Introdução a Produtos Similares de Geração de Vídeos de IA

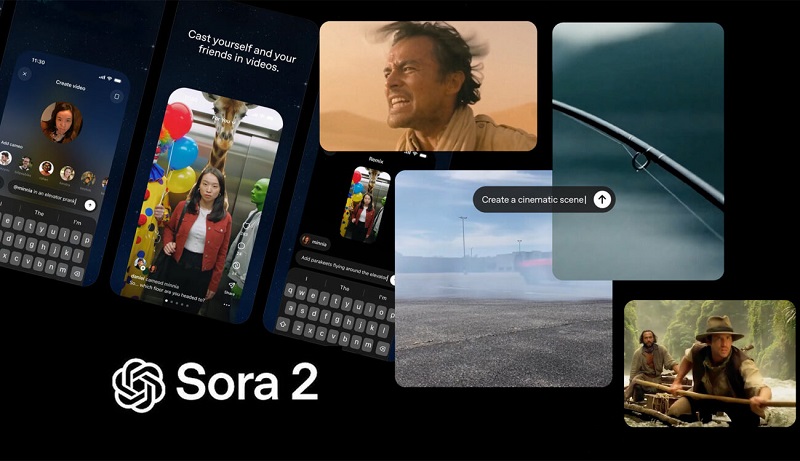

Sora 2 (OpenAI)

O Sora 2 da OpenAI é um modelo de texto-para-vídeo com simulação de mundo e habilidades narrativas excepcionais. Gera vídeos de até 25 segundos (mais longos na versão Pro) e suporta storyboard, interações físicas reais (colisões de objetos, gravidade, fluidos) e áudio nativo (diálogos, efeitos sonoros). É forte em expressão emocional complexa e conteúdo em estilo de mídia social, com inserção de personagens personalizados por meio da função cameo. Requer assinatura ChatGPT Plus/Pro, a partir de cerca de 20 dólares/mês.Comparação com Seedance 2.0

: O Sora 2 tem vantagem em continuidade de longas-metragens e narrativa em nível cinematográfico, mas sua velocidade de geração é lenta e o controle de consistência não é tão flexível quanto o sistema de múltiplas referências do Seedance. É adequado para criadores 'centrados na história'.

Google Veo 3.1 (Google)

O Google Veo 3.1 é avaliado com base em realismo físico e conformidade a prompts. Oferece saída nativa de 4K, vídeos de até 60 segundos, excelente simulação de luz/física e áudio integrado (sincronização labial, som ambiente, diálogo). Destaca-se em consistência de personagens e processamento de múltiplos shots, acessível via Gemini Advanced ou Vertex AI, com entrada a partir de cerca de 19,99 dólares/mês.Comparação com Seedance 2.0

: O Veo 3.1 tem realismo físico e cinematográfico similar ou ligeiramente superior, mas o Seedance é mais eficiente na entrada de referência mista e trabalho repetido rápido. É adequado para produções cinematográficas de qualidade broadcast.

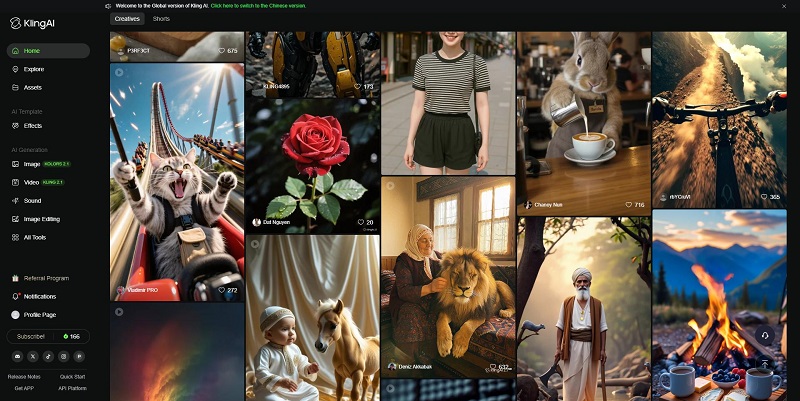

Kling 2.6 (Kuaishou / 快手)

O Kling 2.6 é altamente maduro em geração simultânea de áudio-vídeo, produzindo vídeos com sincronização labial, efeitos sonoros e som ambiente de uma só vez. Tem forte desempenho em movimentos de personagens (especialmente em chinês/dialetos), movimento de alta velocidade (artes marciais, dança) e custo-benefício. Suporta alta resolução, com entrada a partir de cerca de 10 dólares/mês.Comparação com Seedance 2.0

: Ambos têm ótimas habilidades de áudio, mas o Kling é mais natural em diálogos e conteúdo em chinês, além de ser mais barato. O Seedance tem narrativa multi-shot e sistema de referência mais abrangente.

Runway Gen-4.5 (Runway)

O Runway Gen-4.5 é especializado em workflows profissionais. Suporta entrada de texto/imagem/vídeo, pincel de movimento local, sequência multi-shot e consistência de personagens, com áudio nativo e suporte a vídeos de 1 minuto na nova versão. Assinatura a partir de 12 a 15 dólares/mês.Comparação com Seedance 2.0

: As ferramentas de edição e controle de câmera do Runway são mais poderosas, ideais para repetição pós-produção e produção cinematográfica. O Seedance lidera em eficiência de geração e fixação de múltiplas referências de uma vez.

Hailuo AI 2.3 (MiniMax)

O Hailuo 2.3 é forte na geração de movimentos suaves e efeitos especiais. A interface é simples e a velocidade de geração rápida, com baixa taxa de descarte, ideal para FX criativos e estilos de animação em vídeos curtos. Entrada a partir de cerca de 9,99 dólares/mês.Comparação com Seedance 2.0

: O Hailuo é amigável para iniciantes e econômico, ótimo para produção rápida de mídia social. O Seedance é superior em física complexa e controle multimodal.

Luma Ray 3 (Luma Labs)

O Luma Ray 3 é especializado em construção de mundos, clipes longos e saída HDR, forte em vídeos em loop e estilo de sonho/ficção científica. Econômico (entrada a partir de cerca de 9,99 dólares/mês).Comparação com Seedance 2.0

: Sequências longas e produção de atmosfera são semelhantes, mas o sistema de referência e realismo de movimento do Seedance são mais fortes.

WAN 2.6 (Alibaba Afiliado)

O WAN 2.6 é famoso por efeitos especiais, FX criativos e saída de produtos de alta resolução. Destaca-se no suporte a opções de áudio e geração rápida, sendo avaliado como tipo 'pronto para uso'. Entrada a partir de cerca de 10 a 12 dólares/mês.Comparação com Seedance 2.0

: O WAN se destaca em efeitos especiais e acabamento, mas o controle multimodal e narrativa de shots do Seedance são mais flexíveis.

5. Melhor alternativa ao Seedance 2.0: HitPaw FotorPea

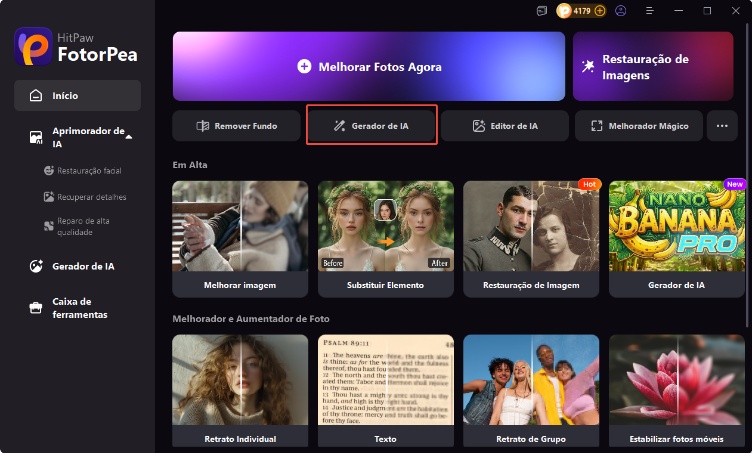

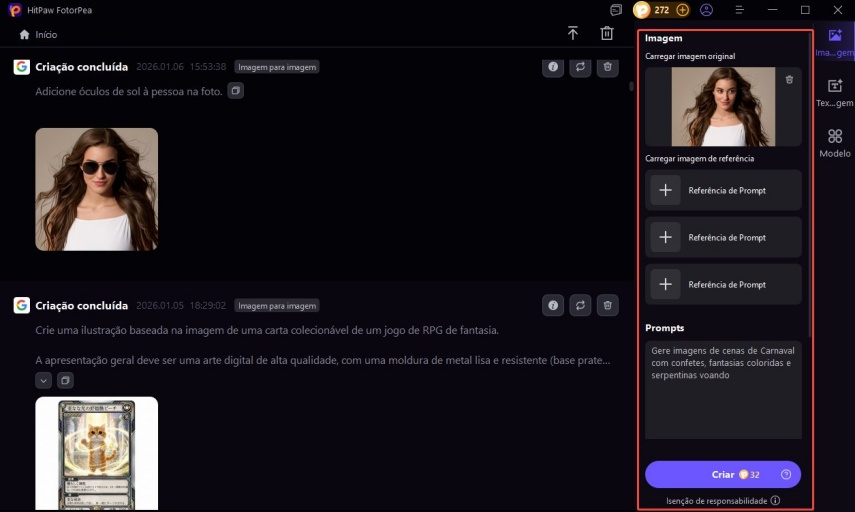

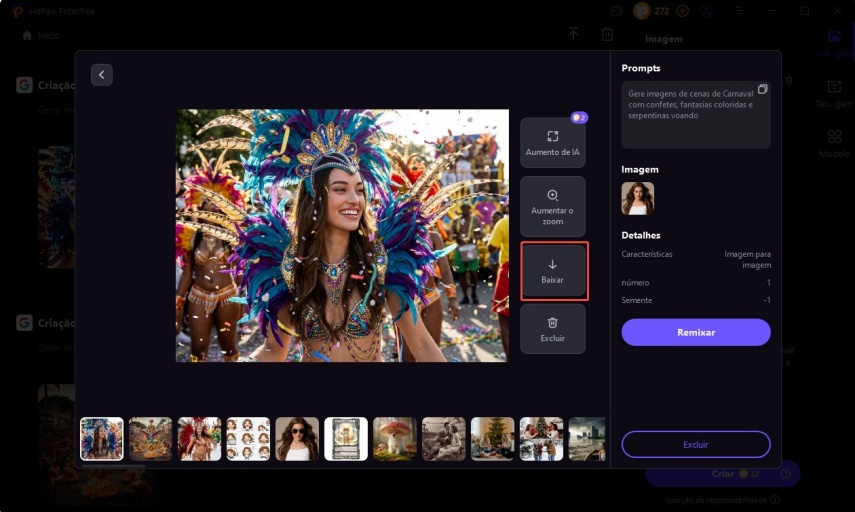

Para criar imagens IA com o FotorPea, siga estes passos simples:

-

1.Abra o FotorPea e vá para a seção Gerador de IA.

-

2.Digite um prompt criativo descrevendo a cena carnavalesca que deseja criar.

-

3. Revise as opções geradas e, quando encontrar a imagem que mais gostar, clique em Baixar para salvar no seu dispositivo.

Conclusão

Em 2026, a competição de vídeos de IA está agora em pleno andamento. O Seedance 2.0 exibe a força do 'ritmo chinês' com seu controle multimodal de nível industrial e velocidade de geração rápida, enquanto modelos estrangeiros brilham em profundidade física e criatividade narrativa. Para criadores de vídeos curtos, diretores de comerciais e cineastas independentes, este ano é o momento certo para experimentar essas ferramentas. O futuro dos vídeos de IA não está mais distante.

Deixe um Comentário

Crie sua avaliação para os artigos do HitPaw