DeepSeek V4: O Que Esperar do MODEL1, Engram e Sparse FP8

DeepSeek V4 promete um grande avanço para modelos de grande escala ao combinar capacidades de contexto longo, inferência de menor custo e recuperação semelhante à memória. Vazamentos iniciais e artigos técnicos apontam para quatro avanços principais - um cache KV hierárquico (MODEL1), decodificação esparsa de precisão mista FP8, um módulo de memória Engram para recuperação de longo prazo e resíduos otimizados com mHC para treinamento mais rápido. Juntos, esses recursos tornam códigos longos e com vários arquivos e agentes de múltiplas sessões muito mais práticos.

Parte 1. DeepSeek V4: Quais São os Destaques?

DeepSeek V4 visa desbloquear uma IA de contexto verdadeiramente longo com uma janela de 1 milhão de tokens, um cache KV hierárquico MODEL1 para descarregamento de memória do host, decodificação esparsa FP8 para inferência mais rápida, uma camada de memória de longo prazo Engram e resíduos mHC que aceleram o treinamento e aumentam a estabilidade. Essas mudanças visam desempenho, escala e custos mais baixos.

- 1.Janela de contexto de 1 milhão de tokens - V4 amplia os limites de contexto de dezenas de milhares para cerca de um milhão de tokens, permitindo a análise de bases de código inteiras ou documentos enormes.

- 2.Cache KV hierárquico MODEL1 - Uma hierarquia de armazenamento coloca os dados KV mais ativos na GPU, KV de frequência média na RAM e KV de arquivo em disco, reduzindo as necessidades de memória da GPU enquanto estende o contexto.

- 3.Decodificação esparsa FP8 (precisão mista) - A precisão seletiva usa FP16 para tokens críticos e FP8 para outros, resultando em grandes ganhos de velocidade com perda mínima de qualidade.

- 4.Módulo de memória Engram - Uma memória de longo prazo baseada em vetores separa o contexto transitório de memórias duráveis (preferências, decisões de design, histórico do projeto) para agentes personalizados e de múltiplas sessões.

- 5.Conexões residuais otimizadas com mHC - O escalonamento residual aprendível por camada ajuda na convergência mais rápida, treinamento mais suave e ganhos modestos de qualidade.

- 6.Suporte nativo multimodal e otimização de hardware - V4 é construído pensando em entradas multimodais e ajustado para uma variedade de hardware de inferência.

- 7.Ecossistema e contexto estratégico - O lançamento está sendo observado como parte de uma corrida de IA mais ampla que levanta questões sobre governança, segurança e cooperação internacional.

Parte 2. DeepSeek V4: O Que a Nova Arquitetura Pode Fazer?

A arquitetura do DeepSeek V4 repensa a inferência e a memória: MODEL1 reduz a pressão na memória da GPU ao descarregar a maior parte do estado KV para RAM e disco, FP8 esparso acelera a decodificação usando menor precisão para tokens não críticos, Engram fornece memória de longo prazo recuperável e resíduos mHC aceleram o treinamento e estabilizam o aprendizado. Juntos, esses recursos tornam agentes de estado longo e de longo prazo acessíveis em escala.

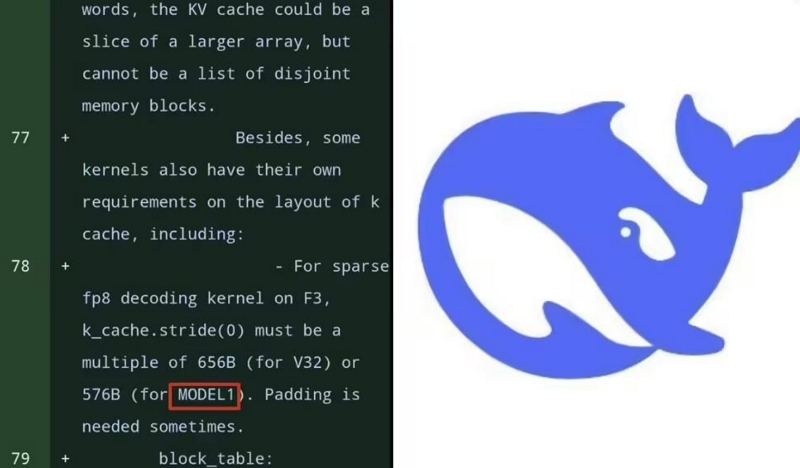

Arquitetura MODEL1 - cache KV hierárquico e por que isso é importante

O problema: caches KV tradicionais escalam linearmente com o histórico de tokens e rapidamente esgotam a VRAM da GPU durante a inferência de sessão longa.

A solução do MODEL1: colocar pares KV ativos na VRAM da GPU, KV de média frequência na RAM da CPU e KV histórico em disco. Esse descarregamento pode reduzir drasticamente as necessidades de memória da GPU, estender as janelas de contexto práticas além dos limites rígidos anteriores e reduzir o custo em comparação com manter tudo na GPU. Os casos de uso reais incluem revisão de código de repositório completo, análise de documentos enormes e assistentes coerentes de múltiplas sessões.

Decodificação Esparsa FP8 - inteligência de precisão mista

A percepção: apenas um subconjunto de tokens influencia fortemente o cálculo do próximo token. Ao pontuar rapidamente a importância do token, o modelo calcula os tokens críticos com maior precisão e o restante em FP8.

Resultados: cobertura FP8 muito maior, quase dobrando a taxa de transferência de inferência, mantendo a perda de precisão mínima - uma alavanca de custo importante para serviços de alto volume.

Módulo de Memória Engram - além das janelas de contexto

Contexto vs memória: V4 separa o contexto de trabalho efêmero das memórias de longo prazo curadas, armazenadas em um banco de dados vetorial.

Como isso ajuda: em vez de reprocessar históricos inteiros, os sistemas extraem e armazenam fatos salientes e, em seguida, recuperam apenas o que é relevante - permitindo assistentes persistentes que lembram preferências, decisões de projeto e resoluções anteriores.

Resíduos Otimizados com mHC - dinâmicas de treinamento mais inteligentes

O que muda: as conexões residuais ganham fatores de escalonamento aprendíveis por camada, para que a rede possa enfatizar ou reduzir o peso das contribuições da camada.

Benefícios: treinamento mais rápido, convergência mais suave e aumento mensurável de qualidade com menor gasto computacional.

Parte 3. Quando DeepSeek V4 Será Lançado?

Sinais iniciais e relatórios sugerem que a DeepSeek está programando um anúncio do V4 para a primeira semana de março de 2026, com vários meios de comunicação e tópicos da comunidade apontando para uma janela de lançamento na mesma semana do Festival das Lanternas, 3 de março de 2026. Ainda há incerteza até que um comunicado oficial seja feito, então os observadores esperam um anúncio ou lançamento em fases a qualquer momento durante essa janela.

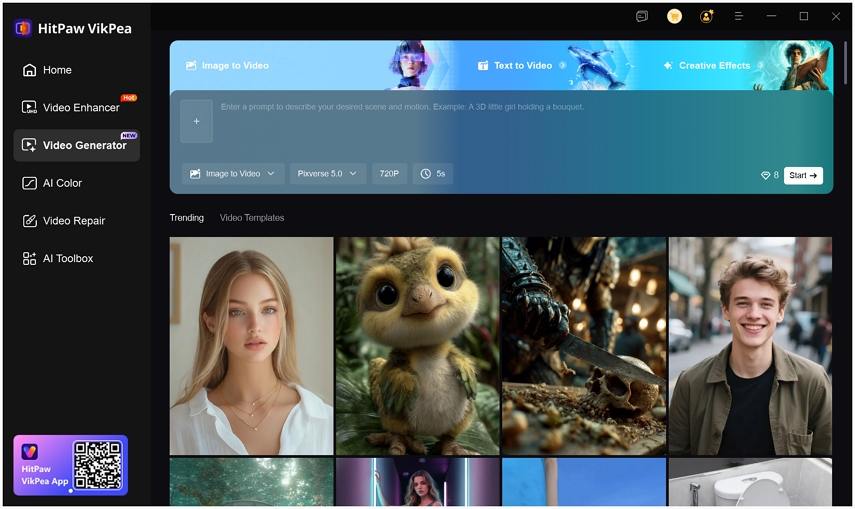

Dica Bônus. Crie Vídeos de IA Impressionantes com o Gerador de Vídeo AI HitPaw VikPea

Se você quer uma maneira prática e amigável para desktop de testar fluxos de trabalho generativos modernos enquanto espera as notícias do modelo, o HitPaw VikPea oferece geração de texto para vídeo e imagem para vídeo, além de ferramentas poderosas de aprimoramento. O VikPea combina vários modelos criativos, controles de predefinição fáceis e aprimoramento em nível de quadro para que os criadores possam construir clipes curtos, transformar imagens em movimento ou polir a filmagem antes da publicação. É uma escolha pragmática para criadores que precisam de resultados visuais rápidos e de alta qualidade sem conhecimento profundo em ML.

- Geração de vídeo por IA a partir de texto ou imagens para produção criativa rápida de vídeo.

- Múltiplos modelos de IA otimizados para diferentes estilos e direções estéticas.

- Configurações personalizáveis de resolução e duração para controlar o comprimento e tamanho final do vídeo.

- Pipeline de aprimoramento integrado aumenta a clareza, cor, nitidez e redução de ruído.

- Interface amigável projetada para resultados rápidos sem conhecimento técnico.

- Processamento em lote e suporte a formatos para fluxos de trabalho profissionais e arquivos grandes.

Passo 1.Instale e abra o VikPea no Windows ou Mac, em seguida, escolha a ferramenta Gerador de Vídeo AI no menu principal.

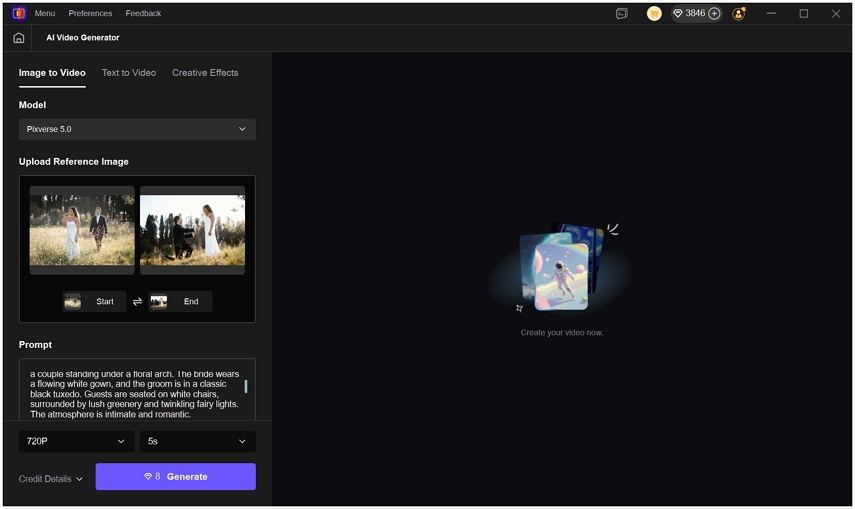

Passo 2.Insira um prompt de texto ou faça upload de imagens: escolha Texto-para-Vídeo para clipes orientados por prompt ou Imagem-para-Vídeo para movimento baseado em quadro.

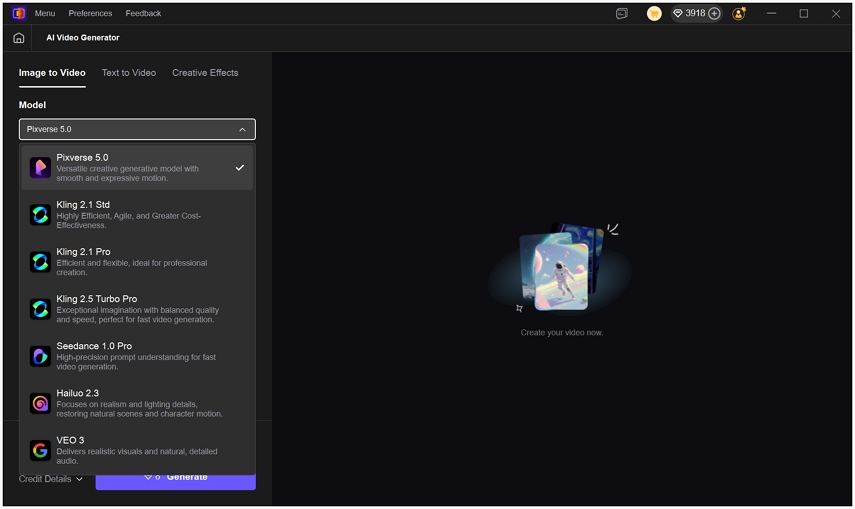

Passo 3.Selecione um modelo e ajuste as configurações de saída, como duração, resolução e controles de estilo.

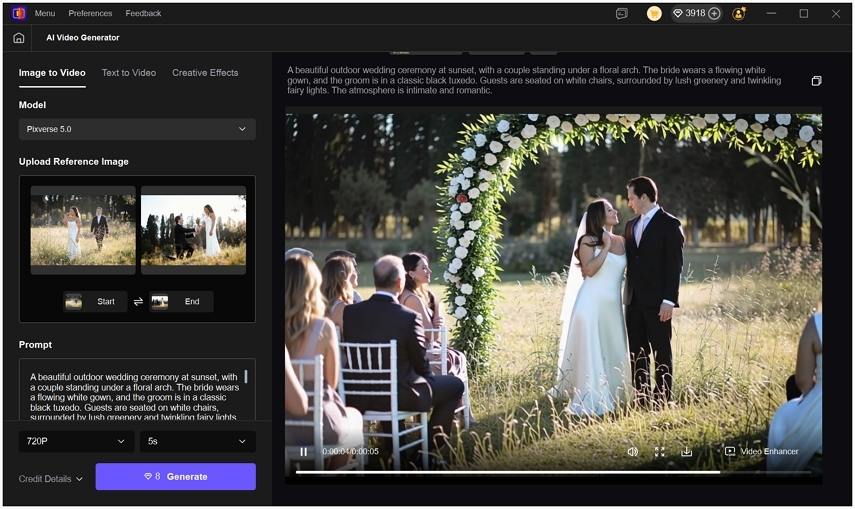

Passo 4.Clique em Gerar, visualize o resultado e salve ou execute o aprimorador integrado para o polimento final.

Parte 5. Perguntas Frequentes sobre DeepSeek V4

Vazamentos iniciais e benchmarks sugerem que o V4 é otimizado para codificação e raciocínio em repositórios longos, mas até que comparações independentes e revisadas por pares sejam publicadas, é prematuro chamá-lo de o melhor modelo de código definitivo. Espere grandes ganhos no raciocínio de base de código, embora o verdadeiro "melhor" dependa da tarefa, latência e compensações de segurança.

Os tópicos do Reddit combinam agregação de vazamentos, testes de desenvolvedores e hype da comunidade à medida que os leitores analisam diferenças de código, referências ao MODEL1 e execuções de teste. Uma mistura de sinais de repositório confiáveis e especulação alimenta discussões de alto interesse.

Atualize cadeias de ferramentas para suportar descarregamento de memória do host, explore padrões de memória vetorial, teste inferência de precisão mista e planeje suítes de avaliação para tarefas de contexto longo. Além disso, certifique-se de que as verificações de governança e os processos de revisão de segurança estejam prontos para novas capacidades.

Conclusão

DeepSeek V4 parece um lançamento de engenharia fundamental que prioriza a escala prática: contextos muito mais longos, inferência mais barata e memórias persistentes que permitem que os agentes atuem mais como colegas de equipe do que como ferramentas efêmeras. Embora a verificação final aguarde o lançamento oficial e benchmarks independentes, as ideias arquitetônicas - hierarquização MODEL1, decodificação esparsa FP8, memória Engram e resíduos mHC - são alavancas concretas para tornar a IA longa e personalizada útil e acessível. Fique de olho na janela de anúncio oficial e execute testes de integração iniciais com ferramentas como HitPaw VikPea se você quiser experimentar fluxos de trabalho criativos multimodais hoje.

Deixe um Comentário

Crie sua avaliação para os artigos do HitPaw